Após um avanço em que nos distanciámos das visões apocalípticas e de sinais criados para distrair os menos experientes, na nossa primeira visão geral deste tipo de tecnologias, vamos continuar a contextualizar o uso da IA enquanto ferramentas úteis para resolver problemas que já enfrentávamos, e até para outros novos que agora podemos abordar, graças ao poder e à abordagem diferente de resolução que permitem.

A IA, mais do que um conceito genérico, afirma-se hoje como um elemento fundamental no tratamento de modelos de dados, graças às múltiplas tecnologias e técnicas que integra — desde as fases iniciais de recolha de dados até aos níveis mais avançados de análise e apresentação.

Quando falamos de dados, a já desgastada expressão “os dados são o novo petróleo”, cunhada pelo matemático britânico Clive Humby em 2006, evidencia a necessidade de processos complexos de tratamento e refinamento para extrair informação e transformá-la em conhecimento com valor. Isto remete-nos para reflexões mais antigas, como a conhecida frase “o conhecimento é poder”, popularizada por Thomas Hobbes no século XVII, mas também para abordagens mais recentes que deram origem a projetos complexos que a IA pode hoje otimizar, com ferramentas e métodos distintos dos tradicionais.

Um conjunto de problemas a resolver que transformou as várias vertentes da IA numa caixa de ferramentas indispensável

O tratamento de volumes massivos de informação — crescentes de forma exponencial —, a sua heterogeneidade e os desafios relacionados com a qualidade e integridade da mesma ... vêm colocando na mesa nos últimos anos, uma série de problemas a serem resolvidos que tornaram as diferentes vertentes da IA numa caixa de ferramentas de aplicação obrigatória em projetos desta dimensão e complexidade. Ao longo deste artigo veremos, com alguns domínios a título de exemplo, como a IA nos pode ajudar nos projetos de tratamento de dados e que já estamos a aplicar no nosso dia a dia (deixaremos as visões mais futuristas para próximas publicações).

Integração e limpeza de dados

Estas tecnologias são aplicáveis desde as fases iniciais do tratamento de dados nos projetos. A própria ingestão de informação pode beneficiar da sua utilização, permitindo, por exemplo, o tratamento de dados não estruturados (que tradicionalmente permaneciam em zonas escuras ou dependiam de um subconjunto de metadados) através do processamento de linguagem natural (PLN), que nos permite padronizar documentos de origem, PDFs e ficheiros Office, extraindo deles informação que possa ser classificada e analisada nas fases seguintes dos nossos processos de transformação e tratamento.

Também torna mais benigna a fastidiosa tarefa de limpeza dos dados. A seleção manual de alternativas, ou os processos pseudo-manuais de reafectação e limpeza de dados por substituição, podem ser apoiados por algoritmos de correção automática de dados (mais ou menos automatizados) que permitem atribuir valores prováveis ou esperados aos dados em falta (ou aos dados que se detetam como manifestamente incorretos). Técnicas como o K-Nearest Neighbors (KNN) encontram valores semelhantes ou comparáveis noutros registos “próximos” do registo com os dados em falta que estamos a processar, ou abordagens mais complexas e iterativas como o algoritmo MICE.

É comum encontrar dados em falta ou incoerentes nas nossas bases de dados. Conjuntos de dados padronizados, por exemplo, podem apresentar discrepâncias na idade, morada ou estado civil do cidadão, ou mesmo informações em falta. Estes algoritmos de correção automática de dados em falta permitem atribuir valores esperados com base no comportamento de cidadãos semelhantes com base na localização, rendimento ou composição familiar, ou simplesmente facilitar a deteção de valores em falta, ou mesmo de valores potencialmente mais inconsistentes, notificando os gestores responsáveis pelo tratamento para revisão manual.

Classificação e segmentação da informação

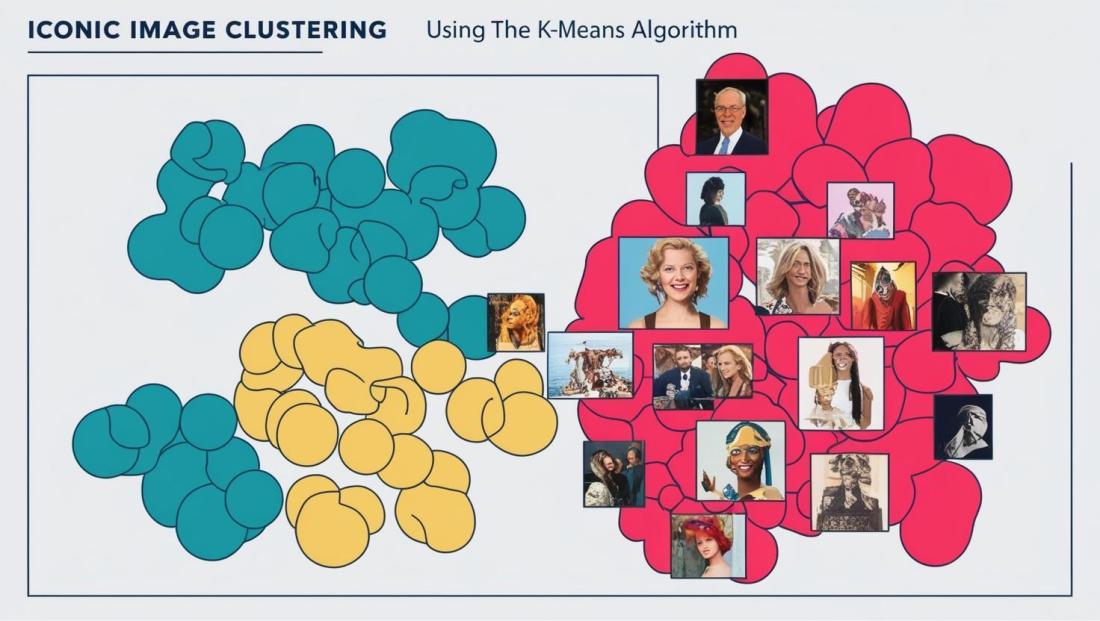

Quando processamos informação, um elemento-chave é a sua classificação segundo determinados valores ou características. Tradicionalmente, estas segmentações eram pré-definidas e, posteriormente, os dados eram tratados através de procedimentos rígidos e pouco automatizados, exigindo um esforço significativo para identificar e posicionar cada elemento de acordo com as suas propriedades.

Para a deteção destes padrões, existem técnicas clássicas de agrupamento, mais conhecidas como algoritmos de clustering, como o K-Means ou o DBSCAN. Estes baseiam-se principalmente em organizar os valores de uma determinada dimensão com base em várias medidas de análise e calcular distâncias entre cada um desses valores, ou diretamente a sua densidade. Isto permite agrupar e estabelecer grupos ou segmentos que possibilitam calcular estas dimensões de acordo com novos critérios de classificação associados ao seu comportamento.

Estes algoritmos são amplamente aplicáveis, e aplicados, quando temos dados estruturados. No caso de dados não estruturados, a estas técnicas juntam-se outras metodologias que os tornam compatíveis com um processo de segmentação. Assim, por exemplo, num processo de classificação de documentos legais, podemos aplicar técnicas de vectorização de textos, como TF-IDF ou word embeddings, que servem de base para posteriores processos de segmentação apoiados nesses vetores.

Estas técnicas também podem ser aplicadas, não apenas para classificar, mas também para detetar padrões anormais ou que não correspondem a comportamentos esperados ou a determinadas normas. São, por isso, aplicáveis no controlo de fraudes ou na deteção de perfis com determinados riscos.

Assim, numa hipotética estratégia de cobrança de impostos, podem ser aplicados algoritmos deste tipo, baseados em dados como históricos de pagamento, níveis de rendimento ou mesmo consumo de outros serviços municipais, que nos permitam gerar perfis diferenciados que classifiquem o nível de risco de incumprimento, ou identificar agrupamentos de utilizadores que, por serem grandes consumidores de serviços (e pagadores, consequentemente), requerem um tratamento específico da nossa parte.

Segurança de dados

Sempre que lidamos com dados, e é importante sublinhar o “sempre”, embora existam contextos em que também seja obrigatório, a segurança no seu tratamento deve ser uma máxima que nos deve guiar e que nunca podemos perder de vista.

Numa primeira instância, a IA pode ajudar-nos em todos os nossos processos de encriptação e anonimização de informação, quando esta precisa de ser transferida entre sistemas. Desde a limpeza e estruturação até à previsão e tomada de decisões automatizadas, os algoritmos de IA estão a transformar a forma como trabalhamos com a informação.

Descobre-se como a Inteligência Artificial está a ser aplicada a diferentes processos de transformação, por vezes externos. Apoiando-nos em sistemas de encriptação dinâmica, podemos proteger os dados sensíveis tanto do acesso dos seres humanos, de acordo com o seu nível de permissão, como do acesso dos processos tecnológicos que têm acesso ao conjunto de dados num determinado momento (e estes processos podem ser outras IA’s, que estamos a normalizar excessivamente ao fornecer informações às máquinas sem as devidas reflexões ...).

Encriptação de dados estruturados, bem como anonimização e ocultação de determinadas informações em documentos eletrónicos em formatos como o pdf, para que o acesso não comprometa a proteção de parte da informação que contêm, que por sua vez pode ser localizada automaticamente, sem conhecimento prévio da sua posição, através de técnicas de OCR e de processamento de linguagem natural (PNL).

Também pode apoiar a deteção de acessos suspeitos. Por exemplo, analisando os dados de auditoria de acesso e aplicando redes neuronais profundas (deep learning), podemos distinguir, ou melhor, ensinar o nosso sistema a distinguir, entre comportamentos normais e outros potencialmente maliciosos, como ataques de phishing, malware ou ataques de negação de serviço.

Previsão de tendências e modelação preditiva

Uma das questões estratégicas que, em algum momento, acabamos por abordar como parte da melhoria da nossa estratégia baseada em dados, é tentar prever comportamentos futuros e, consequentemente, as necessidades associadas, de forma a podermos antecipar tudo o que é necessário para dar resposta da forma mais eficiente possível.

Com base em dados históricos, podemos aplicar técnicas como a regressão linear, que nos permite inferir dados desconhecidos e futuros neste espaço de aplicabilidade, com base em cenários passados dos quais já conhecemos os resultados, e cujas variáveis, embora possam não ser as mesmas, têm alguma dependência ou relação com as que queremos observar. A estas juntam-se outras técnicas, como árvores de decisão, com casuísticas mais ou menos pré-definidas, e até outras mais complexas, como redes neuronais, que, aplicadas a factos sobre dados históricos, permitem estabelecer cenários preditivos através da transmissão de informação entre as suas camadas.

Aplicando estas técnicas a volumes significativos de dados, combinando tendências de pedidos de dados anteriores com a evolução de indicadores sociodemográficos, podem estabelecer-se modelos para otimizar os recursos de uma determinada atividade. Assim, podemos definir a nossa estratégia geral de apoio social com base em modelos preditivos que nos indicam onde devemos aumentar o atendimento dos nossos centros de assistência social, quais os segmentos da população que podem entrar (ou sair) dos grupos que vão necessitar deste tipo de atenção, ou mesmo antecipar a realização de campanhas de sensibilização ou de apoio preventivo a grupos que prevemos vir a necessitar dos nossos serviços.

Tendo em conta todas estas questões, e motivados pelo contexto, podemos concluir a utilidade e os benefícios do uso destas tecnologias no tratamento de dados, bem como a sua utilização “inquestionável” ao enfrentar este tipo de desafios. Isto é verdade e inegável, mas não é isento de riscos significativos que teremos de gestão.

Atualmente, nada custa mais do que a informação.” – A.I. Artificial Intelligence – Steven Spielberg.

“Hoje em dia, nada custa mais do que a informação”. - I.A. Inteligência Artificial - Steven Spielberg. Apesar de todas as técnicas e avanços, isto não significa que a sua adoção seja um processo isento de alguns obstáculos e custos.

A sua própria aplicação acrescenta uma nova camada que devemos ter presente e proteger

E o facto é que, no tratamento de todos estes dados, desde a sua importação até às suas diferentes camadas de processamento e tratamento, podemos incorrer em riscos de segurança. É paradoxal, quando afirmávamos que podíamos recorrer à IA precisamente para proteger a informação, verificar que a sua própria aplicação acrescenta uma nova camada que temos de considerar e proteger. E isto a vários níveis: desde os canais e plataformas que utilizamos para suportar e transmitir dados, uma vez que podem, durante esse percurso, estar a recolher informação para fins diferentes dos pretendidos.

Também em cada fase do processo podemos estar a deixar exposto um ponto de entrada para esta informação, criando condições para que os dados possam ser sequestrados ou até manipulados, comprometendo a integridade dos resultados e das decisões que venhamos a tomar com base neles. Não devemos esquecer que, por mais simples (e por vezes quase mágicos) que estes processos possam parecer, exigem a nossa atenção para que se mantenham devidamente protegidos.

Na sua aplicação, podemos incorrer em novos riscos algorítmicos

Riscos não só em termos de segurança, a sua própria aplicação pode também criar ruído, semelhante (e por vezes pior) ao ruído que estamos a tentar eliminar. Na sua aplicação, podemos incorrer em novos riscos algorítmicos, fazendo com que certos elementos deixem de ser elegíveis, que certos cidadãos nunca recebam um subsídio, ou que nunca se identifique uma necessidade que esteja fora do processo de aprendizagem que tínhamos definido inicialmente. Se encararmos a sua aplicação como “caixas negras” às quais não exigimos a devida transparência nos seus cálculos, podemos estar a colocar um véu sobre as conclusões, ocultando possíveis manipulações indevidas da informação ou discriminações injustificadas...

Além disso, como é óbvio, e à semelhança de qualquer outra tecnologia, estes processos apoiados em IA devem ser aplicados em conformidade com os enquadramentos legais aplicáveis, em função da natureza dos dados tratados. É claro para todos nós que o tratamento de informação sensível, de saúde, de situação económica dos cidadãos, família, etc., deve continuar sujeito à salvaguarda dos direitos e das leis que a protegem, sendo necessário assegurar essa proteção na sua aplicação. Isto inclui tanto os enquadramentos legislativos emergentes que estão a ser desenvolvidos nesta área, como as leis já existentes, aplicáveis de forma geral a qualquer projeto tecnológico que trabalhe com dados.

Aplicar a tecnologia de forma equilibrada

Em todo o caso, estes riscos, transformados em tarefas a resolver através de uma abordagem baseada em estratégias proactivas, continuam a fazer parte da aplicação da IA em projetos de tratamento de dados. Não constituem, portanto, um elemento que deva impedir a sua utilização; são simplesmente questões que devemos ter presentes ao implementar a IA, de modo a tirar partido das potencialidades e soluções que proporciona, tornando os nossos processos de transformação dos dados originais em informação de elevado valor mais eficientes nas fases posteriores de tomada de decisão estratégica. Falamos, assim, da aplicação equilibrada da tecnologia, de forma a garantir a transparência, a segurança e a equidade, permitindo tirar pleno partido dos seus muitos benefícios sem comprometer aspetos éticos e de confiança fundamentais.

A aplicação da IA, um processo de implementação imparável e inevitável

Colocados numa balança e trabalhados com estas premissas de equilíbrio, a aplicação da IA em projetos de tratamento de dados é hoje uma realidade, e um processo de implementação imparável e inevitável.

Vimos, pelo menos em parte e para nos colocar em contexto, a utilização das tecnologias associadas à grande família que englobamos sob o termo IA no tratamento de dados, numa primeira fase de importação e estruturação dos mesmos. Tanto o seu tratamento, como os riscos e questões que temos de considerar na sua aplicação. Também a necessidade inerente à aplicação de qualquer tecnologia, e a IA não escapa à regra, de contar com a transparência e mecanismos de controlo humano que garantam a sua qualidade e a correção dos resultados e conclusões obtidos.

Base nos modelos gerados. E não nos esquecemos, obviamente, desses aspetos; dada a sua extensão e o interesse que suscitam, serão abordados no próximo artigo desta série, onde os desenvolveremos com o devido detalhe. “Até breve”.

Com mais de 20 anos de investigação e colaboração em diferentes projetos de análise de dados. Tem uma vasta experiência em diferentes tecnologias de BI, com especial incidência na plataforma de análise Qlik.